반응형

요새 VLM, LLM, 생성 모델 연구를 하고 있어서, 그에 기본이 되는 VAE 수식 의미 정리를 하고자 한다.

어차피 최신 연구가 아니기도 하니 주요한 부분만 골라서 보고 정리할 것.

아래는 VAE의 대략적 구조. gradient descent를 위해서 reparameterization trick을 사용하여 latent를 표현한다.

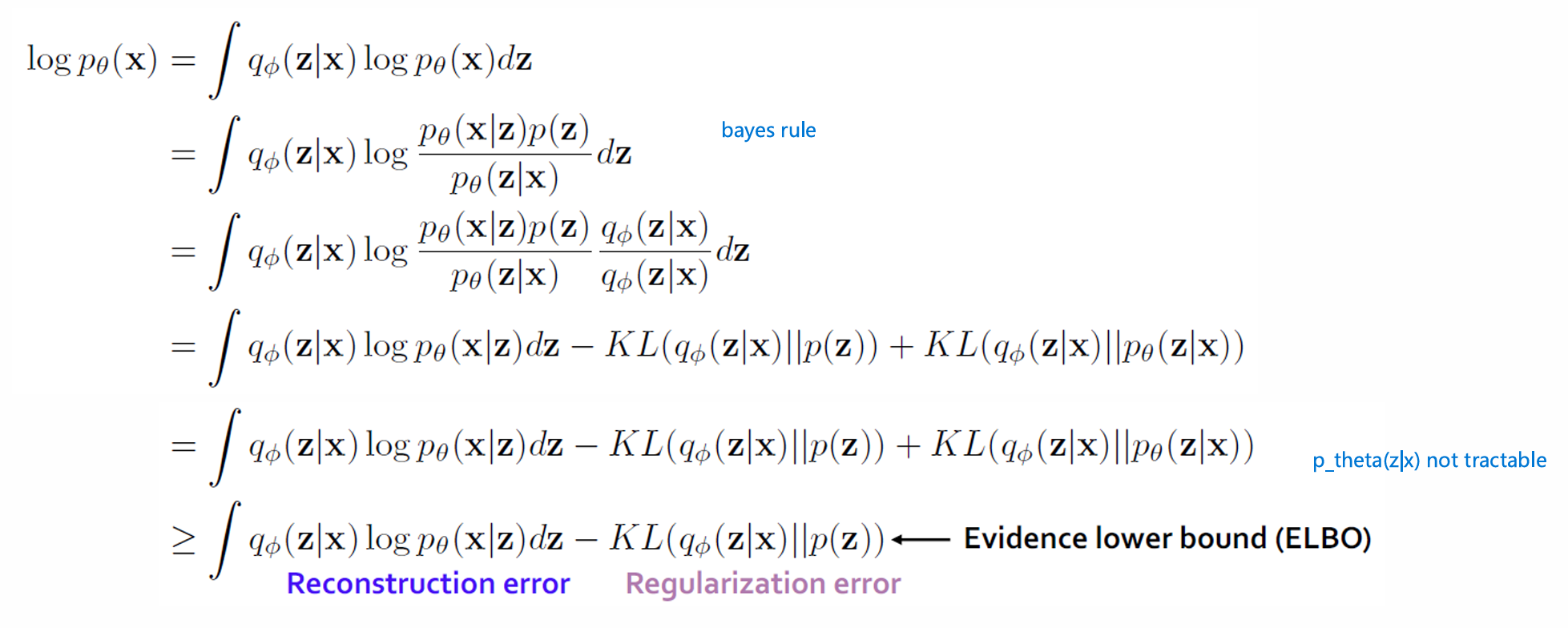

아래는 optimization criterion. 최종적으로 recon error, reg error, 그리고 버리는 항 하나; 이렇게 세가지로 나뉜다.

첫 항은 encoder $q_theta$로 recon target $x$를 구하는 식이니 reconstruction 부분을 담당하고, 두번째 항은 latent prior 등으로 쓰는 gaussian $p(x)$등에 대하여 가까워 지도록 encoder $q_theta$를 KL divergence로 regularize한다.

여기서 $p_theta(z|x)$는 non-tractable하다. bayes rule로 보면, 원래 알아보려는 목적인 $p_theta(x)$가 나오는 순환 논증이 되버리는 문제에, 모든 $z$에 대해서 적분할 수 없으며, 애초에 closed form도 아니라서 구할 수가 없다. 그러므로 사실상 neural network로 계산 할 수 없다고 생각하고 그냥 inequality로 처리한 것.

반응형

'AI > Generative Models' 카테고리의 다른 글

| [Generative Models] VQ-VAE 정리 (0) | 2026.01.20 |

|---|